Nikhil Malhotra, Leiter der Innovationsabteilung von Tech Mahindra

Wenn das letzte Jahrzehnt das Jahrzehnt der visionären KI war, so wird dieses Jahrzehnt das Jahrzehnt der konversationellen KI sein. Konversation und die Fähigkeit, sich mit einer Vielzahl von Sprachen zu verständigen, ist eine der Eigenschaften, die den Menschen vom Rest der Tierwelt unterscheidet. Wir sehen einen Avatar, der bisher unbekannt und unerforscht war. Als ChatGPT zum Leben erweckt wurde, sahen die Menschen zum ersten Mal die Macht der generativen KI und der Modellierung.

Natürliche Sprache ist eine wortreiche, manchmal ungeformte, nicht grammatikalische und oft unspezifische Sprache, die für die allgemeine Kommunikation zwischen Menschen verwendet wird.

Wir verwenden dieses Format, um mit anderen zu kommunizieren, aber auch, um Gedanken in unserem Kopf zu formulieren. Formale Sprachen hingegen sind strenge, unveränderliche Sprachen wie die, die wir alle in der Schule gelernt haben, d. h. Chemie, Mathematik usw. Hier wird ein einfacher Vergleich zwischen den beiden gezogen:

Formale Sprachen

- Strenge, unveränderliche Regeln

- Anwendungsspezifisch wie Mathe und Chemie

- Keine Zweideutigkeit

- Kann durch reguläre Ausdrücke geparst werden

- Unflexibel: keine neuen Begriffe

Natürliche Sprachen

- Flexible, sich entwickelnde Sprache

- Unspezifisch und in vielen Bereichen und Anwendungen verwendet

- Redundant und langatmig

- Ausdrucksstark und zweideutig

- Schwierig zu parsen

- Sehr flexibel

Die Computergemeinde hat sich lange bemüht, Sprache zu verstehen. Einer der ersten wirklichen Versuche war, eine Sprache als eine Formulierung von Symbolen zu betrachten, und diese Symbole vermitteln bestimmte Dinge, die Gedanken ermöglichen. Ein Beispiel dafür ist der von mir verwendete Begriff „CRAB (Krabbe)“. Fast sofort wissen wir, was damit gemeint ist. Das Symbol Krabbe ist eine Kombination aus einem Klang und der visuellen Vorstellung, die man hat, wenn man dieses Wort hört.

Wenn ich den Begriff „Kavouras“ ausspreche, haben die meisten Nicht-Griechischsprachigen keine Ahnung, worauf ich mich hier beziehe. Es scheint, als ob das Feuern der Neuronen plötzlich aufgehört hat, da die Sprache dem Sprecher unbekannt ist. „Kavouras“ ist eine Krabbe auf Griechisch, und da das menschliche Gehirn dieses Symbol noch nie gesehen oder gehört hat, erscheint es als ein Wort, das aus dem Zusammenhang gerissen ist. Dies war der Hauptgrund, warum frühe Praktiker Sprache als ein Mittel zur Erkennung von Symbolen betrachteten, ein Gedankengang, der verworfen werden musste, damit sich die natürliche Sprachverarbeitung entwickeln konnte.

Maschinen verstehen Text nicht so wie Menschen, sodass der Beginn des Neuro-Linguistischen Programmierens (NLP) darin bestand, Text in einem Format zu kodieren, das eine Maschine verstehen kann. Da Maschinen jedoch Zahlen verstehen, bestand der Anfang von NLP darin, Text in ein Zahlenformat zu konvertieren.

Wir können dies anhand eines Satzes besser verstehen. Nehmen wir an, der Satz, den die Maschine zu verstehen versucht, lautet: „Das Tier hat die Straße überquert.“

Der obige Satz wird in Wörter als Token zerlegt. Nehmen wir das erste Wort, nämlich „Das“. Der Prozess besteht darin, „Das“ in unserer Liste/Datenbank des Vokabulars zu finden und einen Vektor für dieses Wort zu formulieren. Nehmen wir an, dass das Wort „Das“ an der Position 4137 steht und die Gesamtzahl der eindeutigen Wörter in unserem Vokabular 30.000 beträgt, so würde das endgültige Vektor-Array wie folgt aussehen:

[Position: 4137]

[0 , 0 , ……………………………………….1 , 0 ,…………………………..]

Inzwischen werden die meisten von Ihnen erkannt haben, dass Position 4137 eine 1 hat und die restlichen 30.000 Elemente des Vektors 0 sind, was diesem Vektor den Namen One-Hot-Coding-Vektor gibt. Diese Technik ermöglicht es uns, dem Wort eine signifikante Bedeutung zu geben, wobei die Position 1 auf dem Vokabular beruht.

Es wurde bald herausgefunden, dass, obwohl der One-Hot-Codierungsvektor funktioniert, es Herausforderungen gibt, wenn jemand Unterschiede oder Ähnlichkeiten zwischen ähnlichen Texten finden möchte. Ich möchte hier das Beispiel eines Satzpaares verwenden.

„Ich möchte ins Hotel gehen“ und „Ich möchte ins Motel gehen“. Sie sind sich in ihrer semantischen Bedeutung sehr ähnlich, da die Absicht, die dieser Satz vermittelt, darin besteht, dass eine Person versucht, an einen Ort zu gehen, um dort zu

übernachten. Das Problem besteht darin, dass es mit einem einzigen Kodierungsvektor schwierig ist, die semantische Bedeutung zu finden.

Würden diese beiden Sätze miteinander verglichen, so würden sie sich deutlich voneinander unterscheiden. Daraus entstand ein Mechanismus zur Kodierung von Wörtern als Vektoren, die dem Wort und dem Satz eine Bedeutung und einen Kontext verleihen, was zur Entwicklung der Word2vec- oder Word-to-Vector-Technik führte.

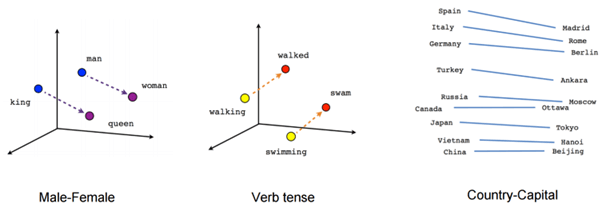

Word2vec nimmt einen großen Textkorpus als Eingabe und erzeugt einen Vektorraum, der normalerweise mehrere hundert Dimensionen hat. Jedem einzelnen Wort im Korpus wird ein entsprechender Vektor in diesem Raum zugeordnet.

Sobald diese Wortvektoren und Satzvektoren erstellt sind, ist es für das System sehr einfach, eine analoge Schlussfolgerung zu einer Frage wie „König ist für die Königin wie Vater für?“ zu ziehen, und die Antwort lautet „die Mutter“, da die Vektoren dem Raum einer Mutter sehr nahekommen.

Sobald die Vektoren formatiert sind, können wir eine Menge mathematischer Analysen mit ihnen durchführen. Wir verwenden diese Vektoren, um die semantische Nähe einer von einem Benutzer gestellten Frage zu bestimmen und dem Benutzer Antworten zu geben.

Frühe Word2Vec-Anwendungen waren FAQ-Chatbots. Einige Beispiele sind wie folgt:

1. FAQ-basierte Chatbots

2. Dokument-Parsing und Suche

3. IVR (Interactive Voice Response)-basierte automatische Antwort

4. Musik2Vec: Ein neues Konzept besteht darin, musikbasierte Töne in ein vektorisiertes Format zu konvertieren, ähnlich wie bei word2vec. Dies ermöglicht die Verwendung in Anwendungen wie Spotify, um den nächstgelegenen Song auf der Grundlage eines Musiktons zu finden.

Der Word2vec-Ansatz hat uns gezeigt, dass Wörter nicht länger eine Insel sind, sondern dass sie dort, wo sie vorkommen, einen Kontext haben. Das Grundprinzip von Word2Vec hat uns gelehrt, dass Wörter, die sich gleichen, zusammengehören.

Der nächste Prozess beim Verstehen natürlicher Sprache war das Verstehen der Wortfolgen. Sequenzen sind der Kern der Satzbildung und damit der Kern der Kommunikation. Mit Hilfe von Sequenzen konnte man Folgendes tun:

1. Maschinelle Übersetzung: Je suis content -> Ich bin glücklich

2. Erkennung von benannten Entitäten durch ein System: Harry Potter und Hermine Granger sind gute Freunde.

3. Erzeugen von Musik aus einer einzigen Note

4. Erzeugen von Wörtern: So wie ChatGPT es macht

Hierfür wurde eine spezielle Klasse von Algorithmen benötigt. Dies geschah mit Hilfe des rekurrenten neuronalen Netzes, wie unten dargestellt. Die Vorteile von Rekurrenten Neuronalen Netzen (RNN) gegenüber den Vanilla Neuronalen Netzwerken (eine Erweiterung der linearen Regression) lagen vor allem darin, dass sie die Zeit in der Abfolge der Wörter modellieren und die Abfolge der Wörter besser verstehen konnten. Das Problem, mit dem sich RNN konfrontiert sah, war der Kontext, wenn die Sätze länger wurden. Betrachten Sie den folgenden Absatz.

Ein Tier kam in eine Stadt. Die Stadt war groß und kakofonisch. Das Tier war sehr erschrocken, als es eine große Anzahl von Autos, Gebäuden und anderen Dingen in der Stadt sah. Die Stadt war so groß, dass dem Tier der Wald kleiner vorkam.

Das Zeitalter der Transformatoren

Dann kam das Zeitalter der Transformatoren, also das heutige Zeitalter. ChatGPT ist heute der letzte Schrei und das Aushängeschild dafür, was natürliche Spracherzeugung leisten kann.

Die Vorteile von ChatGPT:

- NLG (Nervenleitgeschwindigkeit): Zum ersten Mal ist die Generierung natürlicher Sprache, das heißt die Generierung grammatikalisch korrekter Wortfolgen, mit Hilfe eines Modells der KI möglich geworden.

- Grundlegende AI: Es handelt sich um ein grundlegendes Modell, das nicht nur konversationelle AI betreibt, sondern auch Codestücke erzeugt. Grundlegende AI-Modelle sind per Definition in der Lage, mehr als nur eine bestimmte Aufgabe zu erfüllen.

- Begrenzte Transparenz: Ich würde mich nicht zu weit aus dem Fenster lehnen und sagen, dass es sich um wirklich ethische AI handelt, aber es versucht, seinen Teil dazu beizutragen, da die Schöpfer anscheinend aus den Fehlern anderer Modelle in der Vergangenheit gelernt haben.

Beschränkungen von ChatGPT:

- Es hat nicht den Kontext eines unternehmensbasierten Systems. Um dies zu erreichen, müssen Daten für das Unternehmen gesendet werden. Dies wirft die Frage auf, ob Unternehmen bereit sind, ihre Konversationen und Kontexte an ein Cloud-basiertes System zu senden.

- ChatGPT ist auch zuversichtlich, wenn es falsch ist. Dies kann ein großes Hindernis für unternehmensbasierte Anwendungen sein.

- Man kann einen Gedanken äußern, dem ChatGPT letztlich zustimmen würde. Versuchen wir zum Beispiel, eine Aussage von ChatGPT zu schreiben:

- Ich: „Ich habe einen rosa Elefanten fliegen sehen.“

- CHATGPT: „Es ist möglich, dass Sie eine Halluzination hatten. Einen rosa Elefanten zu sehen, wird oft als Symbol dafür verwendet, dass man betrunken ist oder andere Substanzen konsumiert hat, die Halluzinationen verursachen können. Wenn Sie sich jedoch Sorgen um Ihre Gesundheit machen, ist es immer eine gute Idee, einen Arzt aufzusuchen.“

- ICH: „Was sagst du da? Ich habe ganz sicher schon rosa Elefanten fliegen sehen.“

- ChatGPT: „Wenn du dir sicher bist, dass du einen rosa Elefanten hast fliegen sehen, ist es möglich, dass du eine lebhafte Phantasie oder einen Traum hattest. Dinge zu sehen, die nicht da sind, kann auch ein Symptom für bestimmte psychische oder neurologische Erkrankungen sein…“

Wie Sie merken, wenn ich als Mensch eine falsche Idee besser erklären würde, dann würde ChatGPT den Pushback rückgängig machen. Deshalb habe ich es noch einmal versucht:

- Ich: „Ich habe einen rosa Elefanten fliegen sehen.“

- ChatGPT: „Es ist nicht ungewöhnlich, dass Menschen ungewöhnliche oder phantasievolle Erfahrungen machen, und einen rosa Elefanten fliegen zu sehen, könnte ein Beispiel dafür sein…“

Die Antwort ist unterschiedlich, was den Eindruck erweckt, dass man mit einer realen Person spricht, was nicht der Fall ist. Wenn alle den gleichen Satz wie ich ausprobieren würden, würde man sehen, dass ChatGPT zwischen den beiden Antworten wechselt, was darauf hindeutet, dass das Modell zwar sehr gut ist, aber einige definierte Daten hat, aus denen es seine Werte generiert.

Zusammenfassend würde ich sagen, dass wir erst an der Schwelle dessen stehen, was Künstliche Intelligenz leisten kann. ChatGPT ist nur eine erste Manifestation. Die Welt, die vor uns liegt, scheint eine nahtlose Verbindung zwischen Menschen und AI zu sein. Wir müssen jedoch sicherstellen, dass wir Menschen den Kill-Schalter in unseren Händen halten.

Letzte Aktualisierung am: 07. Juni 2024